Пора запускать AI у себя

Искусственный интеллект за последние пару лет перестал быть чем-то экспериментальным — он стал реальным инструментом, который компании используют каждый день. От автоматизации поддержки клиентов до помощи в принятии управленческих решений — AI плотно встроился в рабочие процессы самых разных отделов. Многие фирмы уже не представляют себе повседневную работу без этих технологий. Но при всей пользе, которую приносит искусственный интеллект, далеко не все задумываются о рисках, особенно связанных с конфиденциальностью и утечкой данных.

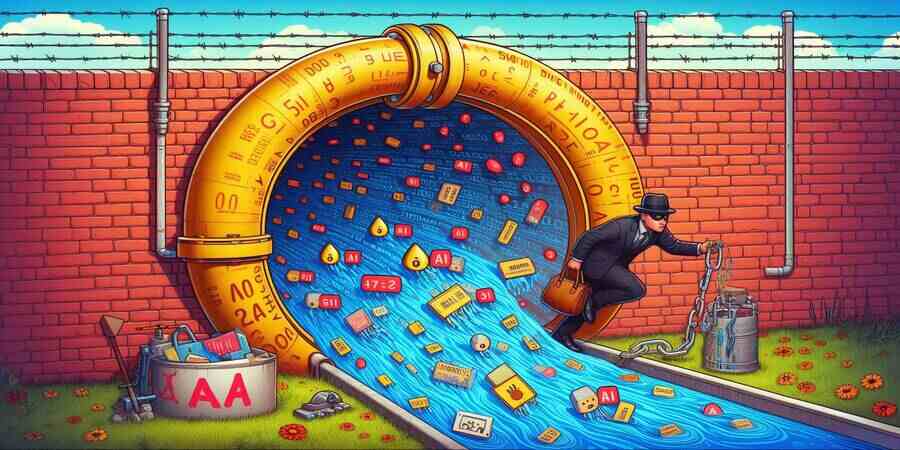

За последний год мы уже не раз становились свидетелями утечек, связанных с использованием облачных AI-сервисов. Казалось бы, внутренние документы, черновики, технические описания или клиентские базы передаются ИИ всего на пару секунд — чтобы сгенерировать текст или выдать ответ. Но этого времени вполне достаточно, чтобы информация ушла туда, откуда её уже не вернуть. Такие данные оказываются в сети, попадают в обучающие выборки или просто теряются за пределами компании. И каждый раз это удар по доверию, репутации и безопасности бизнеса.

Особенно остро проблема встает, когда речь заходит о персональных данных. Если ИИ получает доступ к переписке с клиентами, рекрутинговым резюме, медицинским анкетам или финансовой информации — это уже не просто документы,а это судьбы людей. В случае утечки ответственность несёт не безликий облачный сервис, а сама компания. Утекшие в интернет имена, адреса, номера паспортов или диагнозы остаются в открытом доступе навсегда — и для пострадавших это уже не техническая ошибка, а прямое нарушение закона. А для бизнеса — судебные иски и потеря доверия, которую не восстановить ни деньгами, ни извинениями.

В Оберсете мы понимаем, насколько может быть важна каждая строка данных. Мы видим, как технологии меняют корпоративную среду, и знаем, где проходит грань между удобством и безопасностью. Наша команда ежедневно работает с задачами, где важны не только мощности и точность ИИ, но и контроль, конфиденциальность и соответствие требованиям законодательства. Мы уже помогли ряду компаний выстроить безопасную работу с AI — так, чтобы извлекать максимум пользы без риска утечки. Решения есть. И мы знаем, как внедрять их грамотно.

Локально, надёжно, под Вас

Особенно остро проблема встает, когда речь заходит о персональных данных. Если ИИ получает доступ к переписке с клиентами, рекрутинговым резюме, медицинским анкетам или финансовой информации — это уже не просто документы,а это судьбы людей. В случае утечки ответственность несёт не безликий облачный сервис, а сама компания. Утекшие в интернет имена, адреса, номера паспортов или диагнозы остаются в открытом доступе навсегда — и для пострадавших это уже не техническая ошибка, а прямое нарушение закона. А для бизнеса — судебные иски и потеря доверия, которую не восстановить ни деньгами, ни извинениями.

Необязательно разрабатывать всё с нуля, чтобы получить безопасный искусственный интеллект. Уже сегодня существует множество мощных открытых моделей, которые можно запускать локально — прямо на серверах внутри компании. Мы в Оберсете умеем разворачивать такие решения так, чтобы они полностью работали в закрытом контуре: без подключения к интернету, без внешнего API и без "дырок", через которые могут утечь данные. Всё — от системных настроек до поведения модели — настраивается под конкретные требования бизнеса и безопасности. В итоге вы получаете тот же уровень технологичности, но без компромиссов по конфиденциальности.

Преимущества локального запуска моделей:

- Независимость от внешних сервисов.

- Гибкость и кастомизация.

- Полный контроль над данными.

- Соответствие требованиям законодательства.

Иногда стандартных моделей недостаточно, и компании нуждаются в полностью кастомизированных решениях, которые отвечают конкретным бизнес-целям и задачам. В таких случаях необходимо разрабатывать ИИ с нуля, используя конфиденциальные и зачастую уникальные данные. Это могут быть специфические внутренние процессы, частные данные клиентов или уникальные алгоритмы, которые не могут попасть в публичное пространство. Мы не только понимаем все эти нюансы, но и готовы разрабатывать и обучать такие модели на защищённых серверах, где все данные остаются в безопасности. Мы используем передовые технологии и гарантируем полную изоляцию от внешних источников, чтобы каждая модель была настроена именно под потребности вашего бизнеса, а данные оставались под вашим контролем.

Мы используем передовые технологии, включая Kubernetes, для безопасного развертывания ИИ на локальных серверах. Кубернетис позволяет создавать изолированные среды для каждой модели, обеспечивая полную безопасность данных и максимальную гибкость. Это решение даёт вам полный контроль над обучением и эксплуатацией AI, с возможностью масштабирования по мере роста бизнеса.

Kubernetes для локального AI:

- Изоляция данных и процессов — каждая модель работает в отдельной защищённой среде.

- Масштабируемость — система растёт вместе с вашим бизнесом.

- Контроль и безопасность — полный контроль над обучением и эксплуатацией моделей.

- Автоматизация управления — упрощённое управление инфраструктурой и моделями.

Мы уверены в своей экспертизе и технологиях, которые позволяют безопасно развертывать ИИ локально, гарантируя полное соблюдение конфиденциальности данных. Мы знаем, как решать задачи любой сложности, от обучения моделей с нуля до их внедрения на защищённой инфраструктуре. Однако, помимо технологических решений, важно также помнить о человеческом факторе. Проводите беседы с вашим персоналом, напоминайте о рисках, связанных с использованием сторонних ИИ-сервисов. Не забывайте, что утечка данных — это не просто техническая ошибка, а реальная угроза безопасности вашей компании и её клиентов.

Ваш Оберсет.